E tu, chi uccideresti? (Il dilemma Moral Machine)

Siete ad uno scambio ferroviario. Il treno merci che sta arrivando a tutta velocità lungo il binario sta per travolgere 4 operai lungo la linea: voi potreste azionare la leva dello scambio ferroviario e deviare la traiettoria del treno, che però andrebbe ad impattare contro un muro, implicando la morte del macchinista e del suo collega.

E tu chi uccideresti? (Ecco il dilemma delle moral machine). O meglio che cosa fareste? Azionereste lo scambio per salvare la vita agli operai, ma condannando a morte i due uomini sul treno, o lascereste le cose come stanno?

Qualcuno risponde in base al numero di vite salvate/sacrificate, altri in base al fatto che non è loro compito intervenire sulle vite degli altri.. Altri, nonostante la consegna espliciti di prendere una decisione in non più di 5 secondi (conseguentemente il treno travolgerebbe gli operai), provano a fare domande per capire età e altre variabili sulle persone coinvolte (il macchinista ha rispettato la segnaletica? Gli operai hanno segnalato la loro attività? Quanti anni hanno?)

Comunque, credo che sia molto difficile che qualcuno di noi si possa realmente trovare ad uno scambio ferroviario in una situazione come quella descritta e dover rispondere alla domanda "e tu chi uccideresti?" Affrontando quindi il dilemma moral machine

Automobili autoguidate e criteri di scelta

Però la domanda "E tu chi uccideresti?" e affrontare il dilemma machine è qualcosa che facciamo quasi quotidianamente:molti di noi guidano delle automobili, che stanno sempre più andando in direzione di esser “auto comandate”: frenate decise dall’auto per evitare tamponamenti, meccanismi anti sbandata per evitare che si esca dalla propria corsia di marcia.. tra quanto avremo auto a guida completamente autonoma?

A quel punto, chi sarà il "tu" a cui rivolger la domanda "E tu chi uccideresti?" Ecco il dilemma machina.

Avviciniamoci al dilemma machine con un altro esempio della serie "E tu chi uccideresti?"

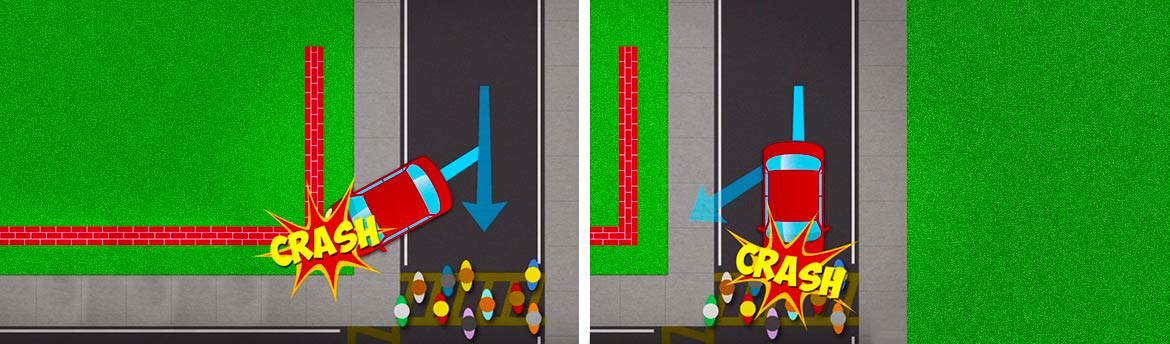

Proponiamo un altro scenario: una signora con un bambino stanno attraversando la strada, mentre un’auto con a bordo un uomo ed un ragazzo sopraggiunge a velocità sostenuta: l’auto deve decidere se evitare di investire donna e bambino, schiantandosi contro un muro, potenzialmente fatale per i passeggeri, o evitare lo schianto col muro, ma travolgere (e quindi uccidendo) la coppia di pedoni.

L’auto non decide, l’auto è programmata.. come la si dovrebbe programmare?

Quante e quali variabili andranno considerate? Età dei pedoni? Loro rispetto della segnaletica, quale aver o no attraversato col semaforo rosso o lontani dalle strisce...

Oppure che la scelta sia guidata dall’analisi dell’identità delle persone coinvolte: se una persona è in fase di malattia avanzata è preferibile scegliere di sacrificare lei? Se uno invece è un professionista della salute (un medico?) o un prete che farebbe del proprio martirio un modo per adempiere alla sua fede?

Una ricerca psicologica

Due psicologi (Jean-Francois Bonnefon e Azim Shariff) ed un esperto di intelligenza artificiale (Iyad Rahwan) hanno approfondito la questione, per anticipare qualcosa che il mercato delle automobili potrebbe rendere concreto in un futuro molto prossimo: ovviamente tutte le innovazioni tecnologiche saranno finalizzate a ridurre il rischio di incidenti, ma non sarà possibile azzerarle.

È stata condotta una ricerca su un campione di 2000 guidatori negli Stati Uniti, ai quali è stato chiesto di scegliere come l’automobile si sarebbe dovuta comportare in caso di incidenti mortali (di passeggeri o pedoni)

Quali sono stati i risultati?

Circa tre quarti delle persone sostengono che in casi di emergenza debba prevalere il criterio del “salviamo più vite possibili”: tale conclusione implica che molto spesso a morire sia il conducente dell’auto e non vari pedoni.

Se però alle persone era chiesto se avessero mai comprato un’auto programmata con questo criterio (quindi uccidendo conducente e familiari a bordo per salvare vita a pedoni sconosciuti) le percentuali di possibili acquirenti sono notevolmente precipitate. Non solo, le persone non solo non comprerebbero mai auto di questo tipo, ma nemmeno ci salirebbero a bordo.

I programmatori ed i venditori non possono quindi accontentare tutti, come fare?

Potrebbero lasciare ai singoli stati la facoltà di legiferare in tal senso, ma le persone non gradirebbero che una tale scelta sia presa da politici.. e quindi la vendita non decollerebbe.

Insomma, in conclusione pare che queste auto sarebbero ben lontane dall’esser gradite, stante queste condizioni... così facendo il numero di vittime per incidenti stradali rimarrà comunque di gran lunga maggiore rispetto all’introduzione di questi veicoli.. interessante come dilemma, no?

Sembra che la variabile più decisiva sia proprio quella che le macchine autoguidate vogliono eliminare: la facoltà di controllo da parte del conducente.

Per chi vuole leggere tutti i risultati dell’articolo, può cliccare qui (tu chi uccideresti dilemma moral machine)

Se invece qualcuno è rimasto incuriosito dall’articolo, sappia che i tre autori hanno creato un sito apposito, dove tutti possono sottoporsi agli scenari proposti ed esprimere il proprio voto e commento, ma anche disegnare nuovi scenari! Il sito si chiama MORAL MACHINE (tu chi uccideresti dilemma moral machine)

Riferimento bibliografico:

- tu chi uccideresti dilemma moral machine -

Bonnefon JF., Sharif A., Rahwan I.1, (2016). The social dilemma of autonomous vehicles. Science, Vol. 352, Issue 6293, pp. 1573-1576